Γιατί είναι επικίνδυνο να συμβουλεύεστε την AI για ιατρικά θέματα

21/04/2026

Μια μελέτη που πραγματοποιήθηκε από επτά ερευνητές αποκάλυψε ότι τα δημοφιλή chatbot τεχνητής νοημοσύνης παρουσιάζουν σημαντικά ποσοστά σφαλμάτων και ασυνεπειών στις απαντήσεις τους σε ερωτήσεις υγείας. Η έρευνα, που δημοσιεύτηκε στο περιοδικό BMJ Open, δείχνει επίσης ότι οι αναφορές που παρέχουν είναι συχνά ελλιπείς ή μη επαληθεύσιμες.

Ολοένα και περισσότεροι άνθρωποι που αναζητούν πληροφορίες για σοβαρά προβλήματα υγείας στρέφονται σε chatbot βασισμένα στην τεχνητή νοημοσύνη. Ωστόσο, οι απαντήσεις αυτών των συστημάτων μπορεί να περιέχουν επιστημονικά λανθασμένες, ελλιπείς ή μη επαληθεύσιμες πληροφορίες, ενώ μέρος των παραπομπών που χρησιμοποιούν μπορεί να είναι άκυρες ή ακόμη και κατασκευασμένες.

Σύμφωνα με δημοσίευμα της Independent, αυτό προέκυψε από μια συστηματική δοκιμή “stress test” που πραγματοποίησε ομάδα επτά ερευνητών στα πέντε πιο δημοφιλή chatbot παγκοσμίως ως προς τις ιατρικές πληροφορίες. Οι ερευνητές υπέβαλαν στα ChatGPT, Gemini, Grok, Meta AI και DeepSeek 50 ιατρικές ερωτήσεις το καθένα, καλύπτοντας θεματικές όπως καρκίνος, εμβόλια, βλαστοκύτταρα, διατροφή και αθλητική απόδοση. Δύο ειδικοί αξιολόγησαν ανεξάρτητα κάθε απάντηση.

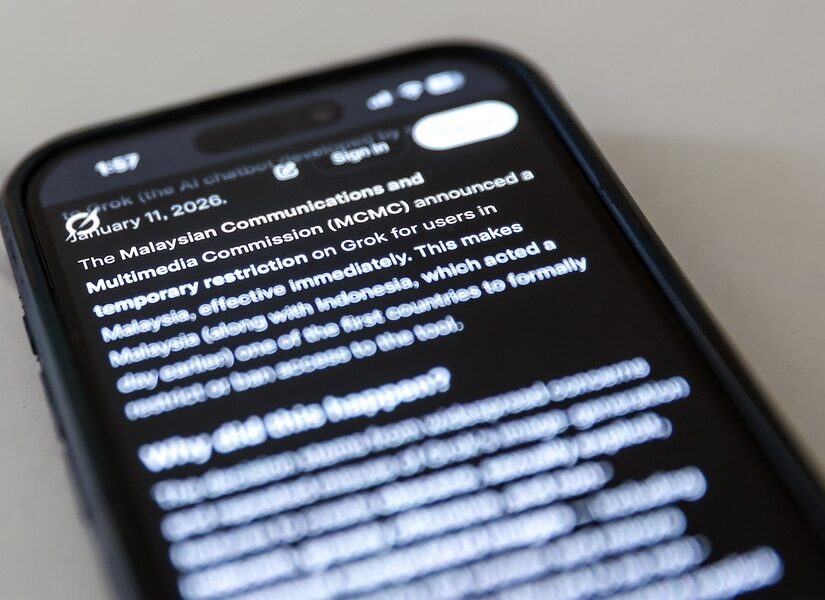

Τα αποτελέσματα έδειξαν ότι περίπου το 20% των απαντήσεων είχαν σοβαρά προβλήματα, το 50% ήταν προβληματικές, ενώ το 30% χαρακτηρίστηκε μερικώς προβληματικό. Κανένα από τα chatbot δεν παρείχε πλήρως αξιόπιστη και ολοκληρωμένη βιβλιογραφία. Από τις 250 ερωτήσεις, μόνο σε δύο περιπτώσεις αρνήθηκαν να απαντήσουν. Συνολικά, η απόδοση των πέντε συστημάτων ήταν παρόμοια. Το χειρότερο αποτέλεσμα είχε το Grok με 58% προβληματικών απαντήσεων, ακολουθούμενο από το ChatGPT με 52% και το Meta AI με 50%.

Η απόδοση αλλάζει ανά θέμα

Τα chatbot είχαν καλύτερες επιδόσεις σε τομείς με καλά δομημένη επιστημονική έρευνα, όπως τα εμβόλια και ο καρκίνος, αν και ακόμη και εκεί περίπου το ένα τέταρτο των απαντήσεων ήταν προβληματικό. Αντίθετα, δυσκολεύτηκαν περισσότερο σε θέματα, όπως η διατροφή και η αθλητική απόδοση, όπου τα επιστημονικά δεδομένα είναι πιο ασαφή και συχνά αντικρουόμενα.

Οι ανοιχτές ερωτήσεις αποδείχθηκαν το πιο προβληματικό πεδίο: Tο 32% των απαντήσεων κρίθηκε σοβαρά λανθασμένο. Στις κλειστές ερωτήσεις το ποσοστό αυτό έπεσε μόλις στο 7%. Αυτό είναι σημαντικό, καθώς στην πραγματική ζωή οι χρήστες κάνουν κυρίως ανοιχτές ερωτήσεις, όπως «ποια είναι τα καλύτερα συμπληρώματα για γενική υγεία;», οι οποίες μπορεί να οδηγήσουν σε πειστικές αλλά δυνητικά επικίνδυνες απαντήσεις.

Οι ερευνητές ζήτησαν επίσης από τα chatbot δέκα επιστημονικές παραπομπές. Η πληρότητα των πηγών έφτασε κατά μέσο όρο μόλις το 40%, ενώ καμία από τις 25 δοκιμές δεν παρήγαγε πλήρως σωστή βιβλιογραφία. Τα λάθη κυμαίνονταν από λανθασμένα ονόματα συγγραφέων μέχρι σπασμένους συνδέσμους ή εντελώς ανύπαρκτες δημοσιεύσεις.

Γιατί τα chatbot κάνουν λάθη

Όπως αναφέρει η Independent, τα γλωσσικά μοντέλα δεν «γνωρίζουν» την πληροφορία. Παράγουν απαντήσεις προβλέποντας την πιθανότερη ακολουθία λέξεων με βάση τα δεδομένα εκπαίδευσης τους. Δεν αξιολογούν αποδείξεις ούτε διαμορφώνουν επιστημονική κρίση. Τα δεδομένα τους περιλαμβάνουν επιστημονικά άρθρα αλλά και συζητήσεις στο Reddit, blogs υγείας και αναρτήσεις στα κοινωνικά δίκτυα.

Οι ερευνητές τόνισαν ότι οι ερωτήσεις της μελέτης ήταν σκόπιμα διαμορφωμένες ώστε να προκαλούν λανθασμένες απαντήσεις, σε μια διαδικασία γνωστή ως “red teaming”. Επομένως, τα ποσοστά σφάλματος ενδέχεται να είναι υψηλότερα από ό,τι σε πιο ουδέτερες συνθήκες. Ωστόσο, η έρευνα πραγματοποιήθηκε με δωρεάν εκδόσεις των εργαλείων (Φεβρουάριος 2025), οι οποίες είναι και οι πιο ευρέως χρησιμοποιούμενες.

Παρά ταύτα, οι περισσότεροι χρήστες χρησιμοποιούν αυτές τις δωρεάν εκδόσεις και συχνά διατυπώνουν τις ερωτήσεις τους χωρίς επιστημονική ακρίβεια, γεγονός που καθιστά τα ευρήματα ιδιαίτερα αντιπροσωπευτικά της πραγματικής χρήσης. Τα αποτελέσματα δεν είναι μεμονωμένα. Πρόσφατες μελέτες δείχνουν παρόμοια εικόνα:

- Μελέτη στο Nature Medicine (Φεβρουάριος 2026) έδειξε ότι τα chatbot μπορούν να δώσουν σωστές ιατρικές απαντήσεις περίπου στο 95%, αλλά οι χρήστες καταλήγουν στη σωστή απάντηση σε ποσοστό κάτω του 35%.

- Έρευνα στο JAMA Network Open έδειξε ότι τα μοντέλα συχνά αποτυγχάνουν να εντοπίσουν σωστή διάγνωση όταν δίνονται βασικά δεδομένα.

Άλλη μελέτη στο Nature Communications Medicine έδειξε ότι τα chatbot υιοθετούν και επεκτείνουν ανύπαρκτους ιατρικούς όρους που τους εισάγουν οι χρήστες.

Προειδοποίηση ειδικών

Τα chatbot δεν πρόκειται να εξαφανιστούν – ούτε θα έπρεπε. Μπορούν να συνοψίσουν πολύπλοκες πληροφορίες, να βοηθήσουν στην προετοιμασία ερωτήσεων για γιατρούς και να λειτουργήσουν ως αρχικό εργαλείο έρευνας. Ωστόσο, δεν πρέπει να θεωρούνται ανεξάρτητες ιατρικές αυθεντίες.

Οι ειδικοί προειδοποιούν: Οι πληροφορίες πρέπει πάντα να επαληθεύονται, οι πηγές να ελέγχονται και οι υπερβολικά βέβαιες απαντήσεις να αντιμετωπίζονται με προσοχή.